Deepfake Teknolojisi Nedir, Nerede ve Nasıl Kullanılır?

Deepfake, bir kişinin mevcut metni, resmi, videoyu veya sesi alıp daha sonra manipüle ettiği bir teknolojidir. Yani bir kişinin gelişmiş yapay zeka (AI) ve sinir ağı (NN) teknolojisini kullanarak bir başkası gibi görünmesi için sahte yeni bir kimlik yarattığı medya teknolojisidir. Birkaç yıl önce ilk ortaya çıktığı yıllarda zararsız olan sonra, deepfake teknolojisi, sonraları adeta kötü niyetli bir silaha haline gelmiştir. Bu makalede, bu deepfake teknolojisinin tam olarak ne olduğu, nasıl çalıştığı, hangi farklı formlarda olduğu ve bir deepfake’yi nasıl tespit edebileceği hakkında bilgiler yer almaktadır.

Deepfake Nedir?

Deepfake, bir kişinin mevcut metni, resmi, videoyu veya sesi alıp daha sonra manipüle ettiği, yani gelişmiş yapay zekâ (AI) ve sinir ağı (NN) kullanarak birine benzemesi için kullandığı sahte medya teknolojisindeki terimlerden biridir. Örneğin birinin ağzına küfürlü kelimeler koymak, bir film kahramanını en sevilen Hollywood süperstarı ile değiştirmek ya da Michael Jackson gibi dans etmek deepfake sayesinde videolar oluşturmak mümkündür. Deepfake içeriği gün geçtikçe katlanarak büyümeye devam etmektedir. Ne yazık ki, deepfake teknolojisi defalarca siyasi olarak öne çıkmak için, rakibin imajını karalamak veya finansal sahtekârlık yapıyormuş lens etmek için kullanılmaktadır. Günümüzde üç temel derinlik türüne ve çalışmalarına izin veren veri bilimini bakıldığında araştırmacıların ve güvenlik danışmanlarının deepfakeslerin kötü niyetli kullanımını engellemek için üzerinde çalıştıkları deepfake algılama teknolojileri bulunmaktadır.

Deepfake, bir kişinin mevcut metni, resmi, videoyu veya sesi alıp daha sonra manipüle ettiği, yani gelişmiş yapay zekâ (AI) ve sinir ağı (NN) kullanarak birine benzemesi için kullandığı sahte medya teknolojisindeki terimlerden biridir. Örneğin birinin ağzına küfürlü kelimeler koymak, bir film kahramanını en sevilen Hollywood süperstarı ile değiştirmek ya da Michael Jackson gibi dans etmek deepfake sayesinde videolar oluşturmak mümkündür. Deepfake içeriği gün geçtikçe katlanarak büyümeye devam etmektedir. Ne yazık ki, deepfake teknolojisi defalarca siyasi olarak öne çıkmak için, rakibin imajını karalamak veya finansal sahtekârlık yapıyormuş lens etmek için kullanılmaktadır. Günümüzde üç temel derinlik türüne ve çalışmalarına izin veren veri bilimini bakıldığında araştırmacıların ve güvenlik danışmanlarının deepfakeslerin kötü niyetli kullanımını engellemek için üzerinde çalıştıkları deepfake algılama teknolojileri bulunmaktadır.

Derin Metin

Yapay zekânın (AI) ve doğal dil işlemenin (NLP) ilk günlerinde, bir makinenin resim veya yazma gibi yaratıcı bir etkinlik yapmasının zor olacağı öne sürülmüştür. 2020 yılına kadar hızlı ileri; araştırmacılar ve veri bilimi profesyonellerinin artımlı çalışmaları tarafından yıllar boyunca inşa edilen güçlü dil modelleri ve kütüphaneleri ile AI tarafından üretilen en yüksek dereceli nesir, artık insani öz ve tutarlılıkla yazılabilmektedir.

GPT-2

Örneğin, Silikon Vadisi’nden araştırma laboratuvarı Open AI tarafından yayınlanan metin oluşturma sisteminin en son cinsini GPT-2 olarak ele alındığında, bu teknoloji, tutarlı metinleri en az bilgi istemiyle çıkarma yeteneği ile hem uzman hem de alan uzmanlarını etkilemiştir. Open AI mühendisleri hurdaya çıkarılan yani web sayfalarından ilgili veri çıkarma yöntemiyle, GPT-2 AI modellemesi ve eğitimi için bir milyar parametreyle birleştirilen 8 milyondan fazla metin belgesi kullanmışlardır. Deepfake ve yapay teknolojilerden yararlanan derin öğrenme gibi diğer teknolojilerin özü, yazılımın veri setleri aracılığıyla beslendiği geçmiş verileri kullanarak kendini düşünmesi ve uyarlaması için eğitimde yatmaktadır. Örneğin GPT-2’yi kullanılarak başlığa yumruk atabilmek ve deepfake metin algoritması bu başlığın etrafında hayali bir haber hikâyesi oluşturmak mümkündür.

Birçok medya evi, yazılımın kendileri tarafından yazılan hikâyeler veya bloglar oluşturmak için deepfake algoritmaları kullanmaktadırlar. Araştırmacılar, Middlebury Terörizm Enstitüsü, Uluslararası Araştırmalar Merkezi ve Terörle Mücadele Merkezi (CTEC) gibi aşırı uç örgütler tarafından ırksal üstünlük ya da radikal mesajlar yayan radikal mesajlar yaymak için kötüye kullanılabilecek bir araç olduğu konusunda uyarılarda bulunmaktadırlar.

Sosyal Medyada Deepfakes

Deepfake teknolojisi Hikayeler veya bloglar yazarken, normal bir kullanıcının fark etmesi zor olan sahte bir çevrimiçi profil oluşturmak için de kullanılabilmektedir. Örneğin, LinkedIn ve Twitter gibi sosyal paylaşım sitelerinde var olmayan Maisy Kinsley adında bir Bloomberg gazeteci, muhtemelen bir deepfaketir. Profil resmi garip, belki de bilgisayar tarafından oluşturulmuştur. Bunun nedeni büyük olasılıkla Maisy Kinsley’in tekrar tekrar Tesla hisse senedi satıcılarıyla sosyal medyada bağlantı kurmaya çalışmasıdır. Satıcı profili, daha iyi bir finansal fayda sağlamak için oluşturulmuştur, yani hisse senedinin hisse fiyatı düşecek, düşük bir fiyattan daha da düşük fiyatta satın alarak yüksek karlar elde etmek içindir. Stratejik ve Uluslararası Araştırmalar Merkezi’nde çalıştığı söylenen Katie Jones adında bir başka profilin, casusluk niyeti ile yapılan bir deepfake olduğu bulunmuştur.

Metinsel Derinliklerin Algılanması

Allen Yapay Zekâ Enstitüsü’nden araştırmacılar, çevrimiçi yüzen sentetik içeriği tespit etmek için Grover adlı bir yazılım aracı geliştirmişlerdir. Araştırmacılar, bu yazılımın % 92 oranında deepfake tarafından yazılmış makaleleri tespit edebildiğini iddia etmişlerdir. Grover, açık kaynaklı bir web arşivi ve tarayıcısı olan Common Crawl’dan derlenen bir test kümesinde çalışmaktadır. Benzer şekilde, Harvard ve MIT-IBM Watson laboratuvarından bir bilim adamı ve ekibi, girilen metnin AI tarafından üretilip üretilmediğini ayırt etmeyi amaçlayan bir web aracı olan Dev Dil Modeli Test Odası’nı tasarlamak için bir araya gelmişlerdir.

Allen Yapay Zekâ Enstitüsü’nden araştırmacılar, çevrimiçi yüzen sentetik içeriği tespit etmek için Grover adlı bir yazılım aracı geliştirmişlerdir. Araştırmacılar, bu yazılımın % 92 oranında deepfake tarafından yazılmış makaleleri tespit edebildiğini iddia etmişlerdir. Grover, açık kaynaklı bir web arşivi ve tarayıcısı olan Common Crawl’dan derlenen bir test kümesinde çalışmaktadır. Benzer şekilde, Harvard ve MIT-IBM Watson laboratuvarından bir bilim adamı ve ekibi, girilen metnin AI tarafından üretilip üretilmediğini ayırt etmeyi amaçlayan bir web aracı olan Dev Dil Modeli Test Odası’nı tasarlamak için bir araya gelmişlerdir.

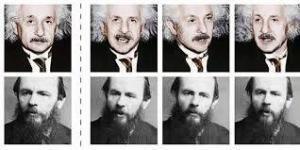

Deepfake Videosu

Sahte fotoğrafların ve videoların hazırlanması, deepfakes’in ana zararlı olabilecek özellikleri arasındadır. Fotoğrafların ve videoların olayları ve hikâyeleri düz metinden daha iyi açıkladığını düşünmek yanlış olmaz, çünkü sosyal medyada her yerde bulunan fotolar göz önüne alındığında, en çok kullanılan deepfake formudur. Modern video üreten yapay zekâ, doğal dil muadilinden daha yetenekli ve belki de daha tehlikelidir. Seul merkezli teknoloji şirketi Hyperconnect kısa süre önce MarioNETte adında tarihi figürlerin, ünlülerin ve politikacıların derin filmlerini oluşturabilen bir araç geliştirmiştir. Bu, yüz ifadeleri daha sonra derin yüzü oluşturulacak hedeflenen kişiliğin üzerine yerleştirilen başka bir kişi tarafından yüz yeniden canlandırılması yoluyla yapılmaktadır.

Deepfake Videosu Nasıl Üretilir?

Bu video hileli, üretken çekişmeli ağ (GAN) adı verilen bir teknik kullanmaktadır. GAN, sinir ağları adı verilen makine öğrenimi dalının bir parçasıdır. Bu ağlar insan beyninin nöronal süreçlerini taklit etmek için tasarlanmıştır. Programcılar belirli bir görevi tanımak veya değiştirmek için sinir ağlarını geliştirebilmektedirler. Deepfake üretimi için kullanılan GAN’da, gerçekçi bir çıktı üretmek için birbirine karşı iki sinir ağı çekilmektedir. Bunu yapmanın amacı, yüzün ayrıntılarının mümkün olduğunca gerçek görünmesi için yaratılmasını sağlamaktır. GAN’ın özü, iki sinir ağı arasındaki rekabette yatmaktadır. GAN’da, resim sahtecisi ve sahtecilik dedektörü art arda birbirini alt etmeye çalışmaktadır. Her iki sinir ağı da aynı veri seti kullanılarak eğitilmektedir.

İlk ağ, işin en gerçekçi görünmesini sağlayacak gürültü vektörleri (rastgele sayılar listesi) kullanmak kaydı ile sahte bir görüntü oluşturmak olan jeneratör olarak isimlendirilmektedir. Ayrımcı olarak adlandırılan ikinci ağ, oluşturulan görüntülerin doğruluğunu belirlemektedir. Hangi görüntünün sahte hangisinin gerçek olduğunu tespit etmek için jeneratör tarafından oluşturulmuş sahte görüntü, veri grubundaki orijinal görüntülerle kıyaslanmaktadır. Bu sonuçlara dayanarak, jeneratör görüntü üretme parametresini değiştirmektedir. Bu döngü, diskriminatör, oluşturulan bir görüntünün sahte olduğunu tespit edene kadar devam etmektedir, bu da daha sonra nihai çıktıda kullanılmaktadır. Bu yüzden deepfakes çok ürkütücü gerçek gibi görünmektedir.

Deepfake videolarını algılama Dünyanın dört bir yanındaki adli tıp uzmanları, her geçen gün bu teknoloji daha fazla kullanıldığından dolayı, deepfakesleri tanımlamak için yollar ve araçlar bulmakta zorlanmaktadırlar. Örneğin, 2018 yılında Buzzfeed tarafından yayınlanan ve dünya çapında izleyicileri aptallaştıran Obama’nın bu tanıtım videosunu bulunmaktadır. Makine öğrenimi araçları kitlelere ulaştıkça, propaganda güdümlü haberleri yaymak veya sadece hedeflenen bir kişiyi taciz etmek için kullanılabilecek ikna edici sahte videolar oluşturmak çok daha kolay hale gelmiştir. ABD Savunma Bakanlığı (DARPA), Medya Adli Tıp adlı deepfakes tespit etmek için bir araç yayınlamıştır. Başlangıçta, program mevcut adli araçları otomatikleştirmek için geliştirilmiştir, ancak deepfakes yükselişi ile AI kullanan deepfakes’e karşı AI kullanmışlardır.

Dünyanın dört bir yanındaki adli tıp uzmanları, her geçen gün bu teknoloji daha fazla kullanıldığından dolayı, deepfakesleri tanımlamak için yollar ve araçlar bulmakta zorlanmaktadırlar. Örneğin, 2018 yılında Buzzfeed tarafından yayınlanan ve dünya çapında izleyicileri aptallaştıran Obama’nın bu tanıtım videosunu bulunmaktadır. Makine öğrenimi araçları kitlelere ulaştıkça, propaganda güdümlü haberleri yaymak veya sadece hedeflenen bir kişiyi taciz etmek için kullanılabilecek ikna edici sahte videolar oluşturmak çok daha kolay hale gelmiştir. ABD Savunma Bakanlığı (DARPA), Medya Adli Tıp adlı deepfakes tespit etmek için bir araç yayınlamıştır. Başlangıçta, program mevcut adli araçları otomatikleştirmek için geliştirilmiştir, ancak deepfakes yükselişi ile AI kullanan deepfakes’e karşı AI kullanmışlardır.

Deepfake kullanılarak oluşturulan video, teknik olarak orijinal videoyla karşılaştırıldığında videonun meta verilerinin dağıtılma biçiminde fark edilebilir farklılıklara sahiptir. Bu farklılıklar, DARPA’nın deepfake algılama aracının deepfake medyayı tespit ederken kaldıramaya çalıştığı matristeki bakışlar olarak adlandırılmaktadır. New York Eyalet Üniversitesi bilgisayar bilimi bölümünden profesör olan Siwei Lyu, deepfake teknolojisi kullanılarak yaratılan yüzlerin nadiren göz kırptığını kaydetmiştir. Bu doğal bir durum olarak görünmemektedir. Bunun sebebi, deepfake güdümlü videoların çoğunun durağan görüntüler kullanılarak eğitilmesinden kaynaklanmaktadır. Yine de, bir kişinin fotoğrafları genellikle gözleri açıkken çekilmektedir. Göz kırpmanın yanı sıra, yüz hareketleriyle ilgili, konuşma sırasında üst dudağı kaldırdıklarında, kafalarını nasıl salladıkları vb. gibi diğer veri noktaları, akışlı videonun sahte olup olmadığı hakkında ipuçları sağlayabilmektedir.

Deepfake Ses

Yapay zekânın ve sinir ağlarının gücü sadece metin, resimler ve videolarla sınırlı değildir. Bir kişinin sesini aynı kolaylıkla klonlayabilmektedirler. Gereken tek şey, sesi taklit edilmesi gereken bir kişinin ses kaydının bir veri setidir. Deepfake algoritmaları bu veri kümesinden öğrenecek ve hedeflenen bir kişinin konuşmasını geliştirecek şekilde güçlendirmektedir. Ticari yazılım piyasada Lyrebird ve Deep Voice, burada AI sese ve tonlamaya alışmadan önce sadece birkaç cümle konuşulması gerekmektedir. Kişi kendini daha fazla sesle besledikçe, bu yazılım sesi klonlayacak kadar güçlü hale gelmektedir. Ses örneklerinin veri kümesini besledikten sonra, sadece bir cümle veya bir paragraf vermek gerekmektedir ve bu deepfake yazılımı metni kişinin sesiyle söylemesini sağlamaktadır.

Deepfake sesi algılama

Günümüzde, çok sayıda özel deepfake ses aracı bulunmamaktadır, ancak geliştiriciler ve siber güvenlik şirketleri bu alanda daha iyi koruyucu çözümler bulmak için bu alanda çalışmalara devam etmektedirler. Örneğin, teknoloji başlangıcı Resemble’daki geliştiriciler, deepfake ses kliplerinin tespiti için Resemblyzer adlı açık kaynaklı bir araç geliştirmişlerdir. Resemblyzer, gerçek veya sahte olduklarını tahmin etmek için ses örneklerinin hesaplama temsillerini türetmek için gelişmiş makine öğrenme algoritmaları kullanmaktadır. Bir kullanıcı değerlendirme için bir ses dosyası gönderdiğinde, gönderilen ses örneğinin benzersiz özelliklerini özetleyen bir matematiksel gösterim oluşturmaktadır. Bu dönüşüm sayesinde, makinenin sesin gerçek veya yapay olarak deepfake araçları tarafından üretilip üretilmediğini algılaması mümkün hale gelmektedir.

Deepfakes Teknolojisinin Geleceği

Deeptrace laboratuvarları tarafından yapılan bir araştırma, 14.000’den fazla deepfake videosunun çevrimiçi olarak gizlendiğini bulmuştur. Ayrıca, üretimlerinde sadece yedi aylık bir sürede % 84’lük bir yükselme kaydetmiştir. İlginç bir şekilde, deepfake videolarının % 90’ından fazlası ünlü kadınların taklit edildiği pornografik malzemedir. Deepfake ciddi bir yükseliş gösterirken sadece mahremiyete değil, aynı zamanda bireylerin saygınlığına da zarar vermek gibi ciddi bir sorun oluşturmaktadır. İronik olarak, yapay zekâ ile çalışan deepfakeslere karşı, yapay zekânın kendisi kullanılmaktadır. İyi bir yapay zekâ derinliklerin tanımlanmasına yardımcı olsa da, bu algılama sistemi eğitim için tükettiği veri kümesine dayanmaktadır. Bu, ünlülerin deepfake videolarını tespit etmek zorlanacakları anlamına gelmektedir, çünkü onlar hakkında çok miktarda veri mevcuttur. Ancak düşük profili olan bir kişinin derinliğini tespit etmek, bu tür algılama sistemleri için zor olmaktadır.

Sosyal medya teknoloji devleri de deepfake tespit sistemleri üzerinde çalışmalara devam etmektedirler. Facebook yakın bir zamanda platformunda deepfake içeriğini belirlemek için otomatik bir sistem üzerinde çalışma yaptığını duyurmuştur. Benzer hatlarda Twitter, bu tür paylaşımları işaretlemeyi ve kışkırtıcı oldukları tespit edilirse silebileceğini önermiştir. Her ne kadar bu teknoloji şirketlerinin çabalarını kabul ve takdir edilse de, bu teknolojinin kötüye kullanımı önlemede ne kadar başarılı olduklarını sadece zaman gösterecektir!

Kaynakça:

https://whatis.techtarget.com/definition/deepfake

https://www.theguardian.com/technology/2020/jan/13/what-are-deepfakes-and-how-can-you-spot-them